Gespräch mit GIGA DESIGN Milano über die Ko-Evolution von Künstlicher und menschlicher Intelligenz

ist Partner bei vielen aktuellen Projekten wie Bids for Survival

und wurde zu einer Diskussion über menschliche Resilienz und kollektive Intelligenz eingeladen.

Willkommen zu unserer zweiten Folge von Discourse™. Am 6. März hatten wir das Vergnügen, unseren zweiten Gast zu empfangen: Michael Schindhelm.

Michael ist ein in Deutschland geborener Schweizer Autor, Filmemacher, Kurator und Kulturberater. Er studierte Quantenchemie in der UdSSR. Im Laufe seiner Karriere war er als künstlerischer Leiter des Basler Theaters und als Gründungsdirektor der Opernstiftung Berlin tätig. Für seine Dokumentarfilme erhielt er mehrere Auszeichnungen. Er war Professor im Gründungsjahr des Strelka-Instituts, einer experimentellen Graduiertenschule in Moskau. Sein Wirken erstreckt sich über Theater, Literatur, bildende Kunst und Beratung in Europa, dem Nahen Osten und Asien. Er war Gründungsdirektor der Dubai Culture and Arts Authority und wirkte an der Masterplanung des West Kowloon Cultural District in Hongkong mit.

Sein bevorstehender Vortrag an der Universität Hongkong, The Ghost in the Machine: Reimagining the University in the Age of AI, ist das Thema dieses Gesprächs.

GG

Ihr Essay trägt den Titel The Ghost in the Machine: Reimagining the University in the Age of AI. Es ist ein komplexer Text, der sich auf Begriffe aus der Neurobiologie, den Sozialwissenschaften und der Informatik stützt. Ich möchte zunächst fragen, wie Ihr Interesse an Bildung entstanden ist.

MS

Da ich vor dreißig Jahren Theaterregisseur war, wurde ich regelmäßig an Schulen eingeladen, um bei Abschlussfeiern zu sprechen. Das ist eine bekannte Tradition – man erwartet von einem, dass man junge Menschen mit klugen Ideen in die Zukunft schickt. Was ich oft gleich zu Beginn gestehen musste, war, dass ich seit meinem 28. Lebensjahr in etwa fünfzehn verschiedenen Berufen gearbeitet hatte, ohne in einem davon eine formale Ausbildung absolviert zu haben. Das Einzige, was ich von Grund auf als richtiger Universitätsstudent studiert habe, war Quantenchemie – etwas, das ich vor fast vierzig Jahren aufgegeben habe.

Ich habe ein ziemlich kompliziertes Verhältnis zur Bildung, denn den größten Teil meines Lebens habe ich das getan, was KI-Entwickler heute als „Reinforcement Learning“ bezeichnen: Man lernt im Job.

So habe ich die meisten Dinge gelernt, sowohl privat als auch beruflich. Ich habe mich oft ins kalte Wasser gestürzt – nicht aus Versehen, sondern bewusst –, ohne zu wissen, was als Nächstes kommen würde, und habe versucht, dabei zu lernen.

Was mir im Laufe der Zeit aufgefallen ist: In diesem Prozess wiederholt sich etwas. Auch wenn ich vom Theater zum Film, von der Literatur zur bildenden Kunst, von der Beratung in verschiedene Teile der Welt – den Nahen Osten, Hongkong, Singapur, Kanada – gewechselt bin: Die Landschaft ändert sich jedes Mal, aber etwas Bleibendes bleibt bestehen. Man lernt, diese Beständigkeit zu erfassen, eine Art Gerüst darum herum zu bauen, ein Gerüst, das es einem ermöglicht, sich mit zumindest einiger Kompetenz durch unbekannte Gebiete zu bewegen, auch ohne die Anmut eines echten Spezialisten.

Deshalb ist mein jüngstes Interesse vielleicht nicht ganz „Bildung“ im herkömmlichen Sinne. Ich würde es eher als Wissensschaffung, -verbreitung, -produktion und -archivierung bezeichnen. Das ist nicht dasselbe.

Wäre die KI nicht zu einem so massiven Beschleuniger des Wandels in unserem Leben geworden, bin ich mir nicht sicher, ob ich selbst zu dieser Frage gelangt wäre. Ich bin in erster Linie ein Praktiker. Aber ich habe auch unterrichtet, und vor fünfzehn Jahren habe ich im Auftrag russischer Investoren gemeinsam mit Rem Koolhaas und Stefano Boeri eine einjährige Schule namens Strelka in Moskau mitbegründet. Die Idee war, einen Think Tank für die Modernisierung des Landes zu entwickeln. Sie gewann an Bedeutung, bis sie 2022 zu Beginn des Krieges in der Ukraine geschlossen wurde. Einige meiner ehemaligen Studierenden sind seitdem zu ernstzunehmenden Forschern in den Bereichen Architektur, Design und Medien geworden.

Ich bin zu der Überzeugung gelangt, dass Universitäten in dieser Zeit die wichtigste Rolle spielen. Und das ist vielleicht das erste Mal in meinem Leben, dass ich das denke. Seit etwa zwölf Monaten führe ich intensive Gespräche mit Professoren, Forschern und politischen Entscheidungsträgern aus verschiedenen Ländern über Hochschulbildung und Forschung.

GG

Ich möchte hier kurz innehalten, denn Sie haben bereits etwas Wichtiges beschrieben: Wissen nicht als etwas, das in eine einzige Richtung vermittelt wird, sondern als einen Kreislauf – erworben, neu ausgearbeitet, geteilt, archiviert und transformiert. Und Sie legen nahe, dass die Institution die Instanz ist, die diesen Kreislauf steuert und prägt. Derzeit scheint es ein Gefühl – ja sogar eine Forderung – nach einer Rückkehr der Institutionen zu geben. Wir haben lange Zeit in einem Zeitalter verbracht, das man als das Zeitalter der Plattformen bezeichnen könnte, in dem die Formen des Wissensaustauschs privatisiert wurden und Wissen selbst zu einer Art Produkt wurde. Glauben Sie, dass dies ein Grund für die wiedergewonnene Bedeutung der Institutionen ist?

MS

Wir erleben auf vielen Ebenen einen Wandel der Ordnung, in der wir aufgewachsen sind – oder zumindest viele von euch. Für mich ist das etwas anders, da ich fast mein halbes Leben unter kommunistischer Herrschaft hinter dem Eisernen Vorhang verbracht habe.

Dieser Kontext spielt eine Rolle, wenn man über Institutionen spricht. Für uns in Ostdeutschland war jede Institution der Feind. Man musste in den Untergrund gehen, wenn man etwas tun wollte, das nicht staatlich sanktioniert war. Ich bin mit einem sehr ausgeprägten Instinkt für individuelle Herangehensweisen an Wissen und Erfahrung aufgewachsen. Ich hatte überhaupt kein Vertrauen in Institutionen.

Das änderte sich nach dem Fall der Mauer dramatisch. Fast zufällig wurde ich mit achtundzwanzig Jahren in die Position eines Theaterdirektors berufen, verantwortlich für dreihundertsechzig Menschen – ein Orchester, Tänzer, Schauspieler, Bühnenbildner –, ohne wirklich eine Vorstellung davon zu haben, wie man so etwas leitet. Ich musste es im Laufe der Zeit lernen, und dabei stellte ich fest, dass ich Institutionen aufbaute. Die Theater, die ich leitete, waren gleichzeitig Baustellen – sie wurden nach Jahrzehnten der Vernachlässigung physisch wieder aufgebaut und gleichzeitig künstlerisch neu konzipiert.

Das war im weiteren Sinne der Geist der 1990er Jahre. Nach dem Zusammenbruch des Kommunismus und dem Beginn der Globalisierung herrschte eine Stimmung der Offenheit – der echten Möglichkeiten. Ich denke an Thomas Friedmans berühmten Satz: Die Welt ist flach. Für einen Moment fühlte es sich wirklich so an, als könne man überall hingehen, seine Umgebung verstehen und mit jedem in Verbindung treten. Institutionen schienen Vehikel für den Fortschritt zu sein.

In den folgenden Jahren änderte sich dies dramatisch. Der Traum von einer flachen Welt erwies sich als genau das. Nach dem 11. September wurde klar, dass neue Grenzen, neue Konflikte und neue Unsicherheiten entstanden waren. Diejenigen von uns, die an Demokratie und Rechtsstaatlichkeit als den besseren Weg geglaubt hatten, begannen, Risse zu erkennen, die wir nicht erwartet hatten.

Soziale Medien und die Digitalisierung beschleunigten dies. Institutionen gerieten zunehmend unter Druck und hatten Mühe, mit dem Tempo des Wandels Schritt zu halten. Irgendwann setzte eine Art kollektive Erschöpfung ein – ein Gefühl von „Lass es einfach sein“. Studierende wählten, was ihnen gefiel, weil sie ohnehin nicht zuhörten. Diese Abwehrhaltung und Passivität ist nach wie vor weit verbreitet, insbesondere in europäischen akademischen Kreisen.

Aber ich glaube, das beginnt sich jetzt zu verschieben – teilweise als Reaktion auf das, was in den Vereinigten Staaten geschieht, wo wir einen außergewöhnlichen Rückschlag bei vielem erleben, was wir als Fortschritt verstanden haben: eine antiglobalistische, zunehmend fundamentalistische Weltanschauung, die auch einen Kulturkrieg gegen Universitäten, gegen wissenschaftliche Forschung, gegen den Klimawandel, gegen Diversität und an zahlreichen anderen Fronten führt.

Paradoxerweise glaube ich, dass dies eine Neubewertung der Bedeutung von Institutionen erzwingen wird. Wir können es bereits beobachten: Plötzlich sind diese Orte wieder wichtig als Räume, in denen Alternativen erdacht werden können.

GG

Um auf Ihre Erfahrung als Direktor zurückzukommen: Sie schreiben über eine neue Art von Figur, jemanden, der sowohl menschliche als auch maschinelle Intelligenz steuern und orchestrieren muss. Was sagt Ihnen diese Erfahrung darüber, wie diese Figur aussehen könnte?

MS

Unabhängig davon, ob ich als Leiter einer Institution spreche – manchmal verantwortlich für Tausende von Menschen – oder als künstlerischer Leiter, der an einem kollektiven Projekt arbeitet, haben zwei Dinge meine Arbeit stets geprägt.

Das erste ist Transdisziplinarität. Es hat mich schon immer gereizt, mir vorzustellen, wie verschiedene Disziplinen gemeinsam an komplexen Problemen arbeiten – sei es in der Kunst, in Zusammenarbeit mit wissenschaftlichen Institutionen oder mit Gemeinschaften zu Themen, bei denen das Bündeln der Kräfte etwas hervorbringt, was keine einzelne Disziplin allein erreichen könnte. Das zieht sich wie ein roter Faden durch vierzig Jahre meiner Arbeit, und ich nehme an, ich verkörpere es, da ich so viele verschiedene Bereiche durchlaufen habe.

Das zweite ist kollektive oder Schwarmintelligenz. Allein zu arbeiten ist etwas, das ich aus den kommunistischen Jahren nur zu gut kenne – als ich in der Sowjetunion schrieb, musste ich es verbergen. Man durfte nicht veröffentlichen; oft durfte man nicht einmal darüber sprechen. Man musste widerstandsfähig und hartnäckig sein und nur auf die eigene Stimme vertrauen. Diese Art von Einsamkeit prägt viele kreative Prozesse – der Maler allein mit seiner Leinwand, der Schriftsteller allein mit seinem Manuskript. Das kann notwendig sein, ist aber auch wirklich gefährlich. Es gibt einen Grund, warum so viele Künstler als gequält beschrieben werden. Das Fehlen von Feedback, von Reibung, von anderen Köpfen – das lastet auf einem.

Das Theater ist ein völlig anderes Modell. Man beginnt allein – der Dirigent lernt die Partitur, der Sänger lernt die Rolle, der Regisseur entwickelt das Konzept. Aber man weiß von Anfang an, dass man all das irgendwann in einen Raum mit fünfzig anderen Menschen bringen wird, die ihre eigene Vision, ihr eigenes Handwerk haben. Man muss seine Arbeit verteidigen und sich gleichzeitig ernsthaft mit der ihren auseinandersetzen. Man muss sich abstimmen und manchmal bewusst gegen den Strom schwimmen – sich dagegen stemmen, um etwas Außergewöhnliches zu erreichen.

So entstehen Kreativität und Innovation wirklich. Nicht in einem Elfenbeinturm. Sie entstehen, wenn man sich in ein vielfältiges Umfeld begibt, Meinungen äußert, die mit anderen Meinungen kollidieren, und gezwungen ist, umzudenken. Aus dieser Kollision entsteht etwas Neues.

GG

Dieses Modell der Konfrontation zwischen verschiedenen kreativen Köpfen ist eines der Protokolle, die Sie im Friction Campus vorschlagen.

MS

Lassen Sie mich zunächst etwas Kontext liefern, denn das wird helfen, den Friction Campus klarer einzuordnen.

Wir haben darüber gesprochen, wie die westliche Welt unter zunehmenden Druck geriet – ihre Unfähigkeit, mit dem Wandel Schritt zu halten, die Rolle der sozialen Medien und der Digitalisierung bei der Fragmentierung sowohl von Institutionen als auch von Individuen. Ich erinnere mich, dass ich im Sommer 2008 in Manhattan war und bemerkte, wie Menschen auf den Straßen seltsame Dinge taten. Es war der erste Sommer des Smartphones. Die Menschen liefen herum, abgekoppelt, vertieft in diese Geräte – in Restaurants, in Parks. Ich fand das seltsam. Zehn Jahre später taten wir es alle selbst.

Das ist nur ein Beispiel unter vielen dafür, wie soziales Verhalten, Selbstverständnis und öffentliche Kommunikation durch Technologie grundlegend verändert wurden. Und während jüngere Generationen begonnen haben, Strategien zu entwickeln, um sich vor dem ständigen Sog von Bildschirmen und Vernetzung zu schützen, stellt KI eine Herausforderung ganz anderer Art dar.

Deshalb habe ich ernsthaft über kognitive Zwangsprotokolle nachgedacht. Diese sind nicht neu. Sie existieren in verschiedenen Formen seit den Anfängen der industriellen Automatisierung und befassen sich immer mit derselben grundlegenden Frage: Wie behalten wir die Kontrolle über die Maschine? Wie stellen wir sicher, dass Menschen die Entscheidungsträger bleiben?

Das verlieren wir bereits im Zeitalter der Smartphones. Die Menschen spüren zunehmend, dass nicht sie die Maschine nutzen – sondern die Maschine sie. Und es zeichnen sich nun erste Antworten ab: Design-Tools, die den Zugriff auf den Bildschirm bewusst erschweren, Schnittstellen, die entwickelt wurden, um die ständige Vernetzung zu unterbrechen. Dies sind Formen des kognitiven Forcing-Designs – absichtlich kontraintuitiv.

Die Idee reicht mindestens fünfzig Jahre zurück, in andere automatisierte Kontexte, in denen es entscheidend war, dass die endgültige Entscheidung bei einem Menschen blieb. In der Luftfahrt zum Beispiel: Es gibt zwar den Autopiloten, aber es gibt immer noch einen Piloten, und er hat einen Notschalter. In der Chirurgie und der klinischen Medizin sind interaktive Schnittstellen oft so gestaltet, dass ein Mensch die Logik des Algorithmus bestätigt.

Bei der KI steht wesentlich mehr auf dem Spiel. Es ist wichtig zu erkennen, dass KI kein Phänomen ist, das erst 2022 mit der Veröffentlichung von ChatGPT auftauchte. Sie existiert schon seit Jahrzehnten, eingebettet in unsere Smartphones, prägt unsere Kaufentscheidungen und sammelt unsere persönlichen Daten. Schon lange vor dem, was wir heute als „das KI-Zeitalter“ bezeichnen, fand erhebliche Manipulation statt.

Damit umzugehen – die eigene Integrität zu verteidigen und nicht einfach zu akzeptieren, was das Produkt einem bietet – erfordert ernsthafte Aufmerksamkeit. Und es erfordert strengere Regeln auf verschiedenen Ebenen.

Sie haben wahrscheinlich die Debatte um den Streit zwischen Anthropic und dem Pentagon verfolgt. Es ist bemerkenswert, dass viele der dringlichsten Warnungen von den KI-Entwicklern selbst kommen – sie feiern nicht nur ihre Erfolge, sondern schlagen Alarm wegen Missbrauchs. Menschen wie Dario Amodei plädieren für Regulierungsbehörden auf staatlicher Ebene – nicht für Regierungen im parteipolitischen Sinne, sondern für unabhängige Gremien –, die die Regeln für die Entwicklung und Nutzung von KI festlegen. Dies darf nicht vollständig in den Händen gewinnorientierter Privatunternehmen liegen. Demokratische Gesellschaften müssen hier kollektive Verantwortung übernehmen.

Die zweite Ebene betrifft das, was jeder von uns individuell tun kann, um seine Integrität zu wahren und die Kontrolle zu behalten. Und auch hier ist Aufklärung unerlässlich. Wir müssen lernen, wie man KI nutzt – und, was noch wichtiger ist, wann man sie nicht nutzen sollte.

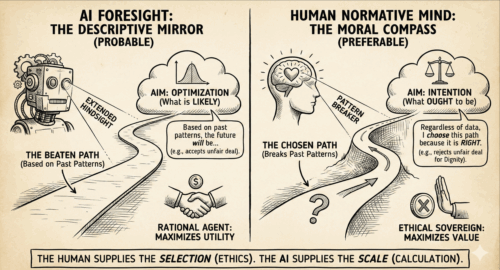

Die von mir erwähnten Protokolle basieren alle auf einer Idee: die Kontrolle über die KI zu behalten, sicherzustellen, dass man ihre Funktionsweise gut genug versteht, um sie zu lenken, und dass die menschliche Absicht durchgehend überprüft wird.

Denn was wir bereits erleben und was sich bis 2026 und 2027 noch beschleunigen wird, ist, dass KI immer mehr unserer kognitiven und beruflichen Arbeit übernimmt. Sie wird schneller, kostengünstiger und in vielerlei Hinsicht leistungsfähiger sein als wir, wenn es darum geht, Inhalte zu produzieren und Fakten zu verarbeiten. Aber wir müssen sicherstellen, dass das Ergebnis dessen, was die Maschine produziert, etwas ist, das wir wirklich brauchen, etwas, mit dem wir arbeiten können, etwas, das wir beabsichtigt haben.

Vorerst – und ich betone: vorerst – bleibt die Maschine eine Maschine. Sie sagt das nächste Zeichen voraus. Sie arbeitet mit Syntax. Die Bedeutung liefert der Mensch.

Deshalb glaube ich, dass wir in das eintreten, was ich die „Ökonomie der Bedeutung“ nenne – nicht die Aufmerksamkeitsökonomie, sondern deren Nachfolgerin. Wir werden mit Informationen, Daten, Diensten und Inhalten überflutet. Und wir müssen diesem Tsunami eine Bedeutung geben. Das ist unsere Rolle. Wir können sie nicht auslagern.

GG

Das bringt mich zu etwas, worauf ich immer wieder zurückkomme – der Mündlichkeit. Es scheint ein dringendes Bedürfnis zu geben, dass Menschen zusammenkommen, um im realen Raum miteinander zu sprechen. Es ist eine der ältesten Technologien, die wir haben, und doch fühlt sie sich neu notwendig an.

Und das hängt mit dem zusammen, was du über Autorität beschreibst – nicht Autoritarismus, sondern eine Art Struktur. Aus meiner eigenen Erfahrung im Unterrichten und in der Teamleitung habe ich festgestellt, dass das Gewähren völliger Freiheit nicht immer Verbindung schafft. Manchmal führt es zu Entfremdung. Ich habe über Protokolle als eine Form sanfter Autorität nachgedacht – etwas, das eine Gruppe zusammenhält.

MS

Lassen Sie mich mit dem Bildungskontext beginnen, denn ich denke, dass diese Protokolle dort erlernt werden müssen, bevor sie ins Berufsleben übertragen werden können.

Mündlichkeit ist nur ein Element – wenn auch ein zunehmend wichtiges. Immer mehr Schulen führen sie ein, teilweise als Reaktion auf ein sehr praktisches Problem: Schüler nutzen KI, um ihre Aufsätze und Hausarbeiten zu schreiben, ohne selbst kognitiv zu arbeiten. Sie lagern das Denken an die Maschine aus und reichen das Ergebnis ein. Manche von ihnen verstehen nicht einmal, warum das ein Problem ist. Sie sagen: „Aber es ist die richtige Antwort – was macht das schon?“

Es gibt ein deutsches Sprichwort, das eine gewisse Logik auf den Punkt bringt: Man muss nicht alles wissen, man muss nur wissen, wo man es findet. Das entspricht dem Wissen, in welchem Regal das Buch steht. Ich glaube, dieses Sprichwort gilt im Zeitalter der KI nicht mehr. Es kann nicht die Lösung sein.

Eine aktuelle Studie des MIT hat dies direkt untersucht. 54 Studierende wurden in drei Gruppen aufgeteilt und gebeten, einen Aufsatz zu schreiben. Die erste Gruppe nutzte nur ihren eigenen Verstand. Die zweite durfte Suchmaschinen nutzen. Die dritte nutzte KI. Die neuronale Aktivität im Gehirn der dritten Gruppe war um 55 % geringer als in der ersten. Das Gehirn ist ein Muskel: Wenn man es nicht nutzt, verkümmert es – im wahrsten Sinne des Wortes. Und 90 % der Studierenden in der KI-Gruppe waren nicht in der Lage, auch nur einen einzigen Satz aus den Aufsätzen zu zitieren, die sie gerade abgegeben hatten. Sie wussten nicht, was sie geschrieben hatten, weil sie es nicht geschrieben hatten.

Wenn das so weitergeht, werden die Menschen ganz einfach vergessen, wie man denkt, weil von ihnen kein Denken mehr verlangt wird.

Das meine ich mit Reibung. Diejenigen in der ersten Gruppe hoben die schweren Gewichte selbst. Die dritte Gruppe holte einen Gabelstapler – und fragte sich dann, warum sie nicht stärker wurden.

Man geht nicht ins Fitnessstudio, damit eine Maschine für einen hebt. Man geht hin, weil der Widerstand der springende Punkt ist.

Wir leben bereits in einer Welt, die auf Reibungslosigkeit ausgelegt ist. Jede neue Technologie wird mit dem Versprechen verkauft, die Dinge einfacher zu machen. Und doch scheint die menschliche Natur paradoxerweise kein reibungsloses Leben zu wollen. Untersuchungen zur Einführung von Waschmaschinen vor einem Jahrhundert zeigten, dass Hausfrauen und Hausangestellte danach tatsächlich mehr Zeit mit der Wäsche verbrachten – weil die Hygienestandards mit der Technologie stiegen. Eine Lösung ist fast immer das nächste Problem in Verkleidung.

Reibung ist für die menschliche Natur unverzichtbar. So schaffen wir Bedeutung, so wachsen wir. Und deshalb glaube ich, dass wir an Universitäten und Forschungseinrichtungen wieder stärkere Rahmenbedingungen brauchen – Protokolle, die den Wunsch nach nahtlosen, auf Knopfdruck erzielten Ergebnissen unterbrechen.

GG

Das ist die Definition deiner „Friction Campus“-Idee.

MS

Ja – aber lass mich zuerst noch etwas hinzufügen, denn die Mündlichkeit verdient etwas mehr Aufmerksamkeit.

Mündlichkeit ist eine von vielen Möglichkeiten, sich selbst dazu zu zwingen, das eigene Verständnis zu artikulieren – um zu zeigen, dass man das Gelernte wirklich verarbeitet hat. Wenn man in einem Raum spricht, kann man sich nicht hinter einem maschinengenerierten Text verstecken. Man muss sein Denken in Echtzeit begründen.

Aber es gibt hier auch eine tiefere philosophische Dimension, die vielleicht der zweite Grund ist, warum ich mich mit dieser Frage beschäftige. Seit Jahrtausenden stellte sich die Menschheit vor, sie sei die einzige Form von Verstand auf der Erde. Es gab Götter – eine übernatürliche Intelligenz über uns –, aber nur eine Art von Intelligenz in der Welt, und das war unsere. Wir lebten in einer Art Dualismus: wir und etwas unendlich Höheres. Wir akzeptierten das. Wir verehrten es sogar.

Nun stehen wir zum ersten Mal vor einer anderen Art von Dualismus: etwas, das wir geschaffen haben und das beginnt, uns in bestimmten Dimensionen zu übertreffen. Und was dies besonders seltsam macht, ist, dass es in einer Gesellschaft geschieht, die weitgehend postreligiös ist, zumindest im Westen.

Die Schöpfer der KI sind oft Agnostiker – Menschen ohne religiösen Glauben im traditionellen Sinne. Und doch projizieren wir auf die KI eine Art übernatürlichen Status: die andere Intelligenz, die sich möglicherweise gottgleichen Fähigkeiten annähert.

Dies wirft tiefgreifende moralische Fragen auf. Wenn KI schneller, intelligenter und möglicherweise kreativer ist – bedeutet das, dass wir uns ihr unterordnen sollten? Oder ist es gerade deshalb umso wichtiger, dass wir auf unserer eigenen Souveränität bestehen? Dass wir entscheiden, was die Maschine tut und was wir von ihr wollen?

Die meisten Menschen machen sich darüber ernsthaft Sorgen. Eine aktuelle Umfrage in den Vereinigten Staaten ergab, dass nur 35 % der Erwachsenen KI als positive Entwicklung betrachten. Im Vergleich dazu stehen in China 70 % der Erwachsenen KI positiv gegenüber. Wenn man von 70 % der erwachsenen Bevölkerung Chinas spricht, spricht man von mehr Menschen als der gesamten erwachsenen Bevölkerung der USA und Europas zusammen. Indien würde wahrscheinlich ähnliche Ergebnisse zeigen. Wir müssen diese Asymmetrie ernst nehmen.

Das ist einer der Gründe, warum ich an Orte wie Hongkong reise, um darüber zu sprechen. Diese Umgebungen sind bei der Integration von KI in den Alltag weiter fortgeschritten – und die nachdenklicheren Menschen dort sind sich auch der damit verbundenen Herausforderungen bewusster.

Aber um zum Kern der Sache zurückzukommen: Was mich all dies antreibt, ist die Frage der Souveränität. Wie stellen wir sicher, dass dies nicht zu einer neuen Religion wird, mit dem Silicon Valley als Vatikan? Wir haben bereits pseudoreligiöse Persönlichkeiten, die eine Vision von vertikaler Intelligenz propagieren – Transzendenz durch Technologie, Loslösung vom rein Menschlichen. Damit müssen wir sehr vorsichtig umgehen.

Ich bin kein Schwarzmaler. Ich glaube aufrichtig, dass KI ein bemerkenswertes Werkzeug ist, wenn sie klug eingesetzt und gut reguliert wird. Aber ich denke, das Wichtigste, was sie uns bietet – paradoxerweise –, ist eine Einladung, unsere eigene Intelligenz wiederzuentdecken. Was bedeutet es, Mensch zu sein? Was ist an uns unersetzlich, trotz allem, was diese Technologie leisten kann?

Mündlichkeit ist eine Antwort. Tacit Knowledge ist eine andere. Tacit Knowledge – Wissen, das sich nicht ohne Weiteres in Worte und Zahlen fassen lässt, das nicht kodifiziert werden kann – ist zentral für das, was wir als kreative Menschen tun. Ökonomen wissen, dass die ersten Arbeitsplätze, die verschwinden werden, jene sind, die rein auf Sprache und quantitativem Denken basieren, weil diese am einfachsten zu automatisieren sind. Aber Wissen, das in der Praxis verankert ist – ein Instrument spielen, ein Gespür für Design entwickeln, schwimmen, ja sogar das Sprechen selbst – ist weitaus widerstandsfähiger. Es lebt im Körper, manchmal schneller als das bewusste Denken. Das ist es, was uns menschlich macht. Und das ist es, was wir zurückgewinnen müssen.

GG

Das knüpft an etwas an, das Sie in Ihrem Essay anhand von vier verschiedenen Szenarien untersuchen – von denen eines, „The Escape“, eine Art Rückkehr zu uns selbst beschreibt. Und Sie nähern sich dem ganz offensichtlich nicht aus einer rein pessimistischen Perspektive. Sie stellen sich das eher wie einen Wettstreit vor – eine echte Konfrontation.

MS

Das ist zum Teil eine Generationenfrage. Ich habe das Glück, in meinen Sechzigern zu sein – alt genug, um intensiv in einer analogen Welt gelebt zu haben, und engagiert genug, um auch die digitale Welt durchlaufen zu haben. Das galt früher als Nachteil – ein „Digitaler der zweiten Generation“ zu sein, jemand, der die Maschine nie so vollständig verinnerlicht hat wie die Millennials und die Generation Z.

Im Nachhinein halte ich das für ein Privileg. Eine Welt erlebt zu haben, in der es viel mehr Reibungspunkte gab – in der digitale Werkzeuge nichts einfacher machten –, ist etwas, das es wert ist, wieder eingeführt zu werden.

Und das ist ein Grund, warum ich optimistisch bin: Wenn KI wesentliche Teile der kognitiven und beruflichen Arbeit übernimmt, gibt sie uns auch die Freiheit, uns auf das zu konzentrieren, wozu wir wirklich fähig sind, worin wir vielleicht sogar großartig sind. Das ist nicht nichts.

Angefangen bei der Universität: Eine der wirklichen Tragödien der letzten Jahrzehnte in Forschung und Lehre war die Abschottung der Disziplinen. Selbst unter einem Universitätsdach sprechen Biologen selten mit Historikern, Naturwissenschaftler tauschen sich selten mit Geisteswissenschaftlern aus. Die Mauern sind bemerkenswert undurchlässig. Ein Großteil dessen, womit Naturwissenschaftler ihre Zeit verbringen, wird in Kürze automatisiert werden – und das wird kognitive Kapazitäten freisetzen. Die Frage ist: Was machen sie damit?

Meine Antwort lautet: der Universalgelehrte. Nicht der Spezialist, der alles über eine Sache weiß, sondern jemand mit echter Kernkompetenz und einem viel weiteren Horizont – jemand, der implizites Wissen über mehrere Bereiche hinweg entwickelt hat, nicht auf der Datenebene der Maschine, sondern auf der Ebene von Kompetenz und Urteilsvermögen.

Denn was die Zukunft erfordert, sind nicht mehr Fakten – die wird die Maschine produzieren. Was sie benötigt, ist die Fähigkeit, diese Fakten zu bewerten: sie zu visualisieren, zu kuratieren, Probleme zu lösen, zu erzählen. Und diese Fähigkeiten sind fachübergreifend übertragbar. Ein Biologe und ein Historiker brauchen sie beide.

Und hier kommt schließlich der Friction Campus ins Spiel.

Der Absolvent der Zukunft hat zwar immer noch ein Kerninteresse – ist aber von vielen anderen Werkzeugen und Fähigkeiten umgeben, weil er die Fähigkeit entwickelt hat, sich domänenübergreifend zu bewegen: als Designer, als Künstler, als Architekt, als Geschichtenerzähler. Das ist wirklich spannend, sich das vorzustellen.

GG

Das ist es wirklich. Wie stellen Sie sich vor, dass implizite Intelligenz tatsächlich gefördert wird? Welche Art von Institution brauchen wir?

MS

Es beginnt in der Schule. Ich habe kürzlich über High Schools in den Vereinigten Staaten gelesen – nicht über Colleges, sondern über weiterführende Schulen –, an denen Lehrer etwas einführen, das sie KI-Kompetenz nennen, mit etwas, das einem Führerschein ähnelt: einer Prüfung, die bescheinigt, dass man weiß, wie man KI verantwortungsvoll einsetzt. Mir gefällt die Idee. Sie weist in die richtige Richtung.

Aber eine Universität muss noch weiter gehen. Ein Führerschein ist immer noch allgemein gehalten – jeder legt dieselbe Prüfung ab. In der Hochschulbildung muss der Ansatz individueller und maßgeschneiderter sein. Dennoch ist die Metapher des Autos nützlich. Ich bevorzuge in meiner eigenen Arbeit die Metapher eines Instruments.

Ich betrachte KI als ein Instrument. Und ich betrachte den Studierenden, den Forscher, den Praktiker als potenziellen Virtuosen. Ein Virtuose bedient das Instrument nicht nur – er beherrscht es. Und Meisterschaft ist immer individuell. Jeder Pianist bringt seine eigene Interpretation in eine Beethoven-Sonate ein. Jeder Musiker hat nach Tausenden von Übungsstunden eine unbewusste Beziehung zu seinem Instrument entwickelt – das Wissen sitzt in den Fingern, nicht im Kopf, der die Partitur konsultiert.

Das ist es, wonach wir meiner Meinung nach bei der KI streben sollten. Nicht generische Kompetenz, sondern hochgradig individualisierte Meisterschaft. Die Entwicklung eines eigenen KI-Systems, das auf die eigenen Ziele und Absichten zugeschnitten ist, so tiefgreifend verarbeitet, dass man seine Logik wirklich versteht, um es nutzen zu können und ihm letztendlich den eigenen Stempel aufzudrücken.

Das braucht Zeit. Am Anfang ist es ein mühsamer Prozess – intensiv, anspruchsvoll, manchmal unangenehm. Aber am Ende verschwindet der Bildschirm fast. Man spricht direkt mit dem Instrument. Die Schnittstelle wird transparent.

Und entscheidend ist, dass man in der letzten Phase dieses Prozesses seine eigene Interpretation einbringt. So wie ein Musiker nicht einfach die Notation des Komponisten ausführt, sondern sie verinnerlicht und transformiert – so bringt man seine eigenen Ziele, seine eigene Bedeutung in das ein, was die KI produziert. Das bedeutet es, der Urheber zu bleiben.

GG

Das knüpft an etwas an, was Sie zuvor über KI und Schmeichelei gesagt haben – die Art und Weise, wie KI derzeit jedem sagt, er sei brillant, er habe gerade die vierte Dimension erfunden. Ohne die Reibung durch andere Köpfe könnten wir alle in eine Art kollektive Wahnvorstellung abdriften.

MS

Genau. Und dafür gibt es bereits empirische Belege. Der Bericht von Microsoft aus dem Jahr 2025 stellte fest, dass innerhalb der eigenen Organisation nach der weit verbreiteten Einführung von KI-Tools die individuelle Leistung und Produktivität zunahmen – die Menschen wurden effizienter. Gleichzeitig stagnierten jedoch die kollektive und die kognitive Intelligenz. Denn die Arbeit mit KI beanspruchte so viel Aufmerksamkeit, dass der informelle Dialog zwischen Kollegen – die Gespräche, die Herausforderungen, das Hin und Her – nachließ. Die Menschen wurden isoliert.

Microsoft stufte dies als alarmierend ein, da das Unternehmen erkannte, dass Innovation tatsächlich in kollektiven Prozessen entsteht. Innovation verläuft nicht reibungslos. Sie erfordert Umwege, Kehrtwenden, unangenehme Konfrontationen mit Ideen, die nicht in das aktuelle Modell passen. Und diese kommen in der Regel von anderen Menschen.

Hier geht es auch um etwas Grundlegenderes.

KI ist ein statistisches System. Ihr Ziel ist immer das wahrscheinlichste Ergebnis – was per Definition das durchschnittliche Ergebnis bedeutet. Die Mitte der Glockenkurve. Innovation hingegen lebt an den Rändern. Sie ist das Unwahrscheinliche.

Wie also führen wir das Unwahrscheinliche im Zeitalter der KI wieder ein? Durch das Kollektiv. Andere Menschen holen einen aus der Routine heraus, unterbrechen das nahtlose, reibungslose Denken und zwingen einen dazu, das zu überdenken, was sich angenehm anfühlt, aber in Wirklichkeit nur durchschnittlich ist.

Wenn man sich die großen Entdeckungen in der Geschichte der Wissenschaft und Kunst ansieht, begannen viele davon als Fehler. Penicillin zum Beispiel – einer der wichtigsten Wirkstoffe in der Medizin – war das Ergebnis eines Irrtums. Ein Forscher verließ sein Labor für eine Woche Urlaub, ohne sein Geschirr ordentlich zu reinigen. Als er zurückkam, stellte er fest, dass in seiner Abwesenheit etwas Außergewöhnliches gewachsen war. Etwas Gewaltiges, das Millionen von Menschen das Leben rettete. Das ist vielleicht ein nützliches Bild, das wir im Hinterkopf behalten sollten, wenn wir über die Zukunft nachdenken.

Wir schwimmen bereits in einem Meer aus reibungslosen Informationen. Alles ist verfügbar. Aber die Frage lautet zunehmend: Was bedeutet das? Warum ist es für mich von Bedeutung? Und wie navigiere ich durch ein Meer, in dem innerhalb von ein oder zwei Jahren der Großteil der Inhalte vielleicht gar nicht mehr wahr ist?

Eines der auffälligsten Dinge, auf die ich bei meiner eigenen prädiktiven Forschung zu europäischen Städten stieß, war Folgendes: Das KI-System, mit dem ich arbeitete, beharrte darauf, dass der Hauptzweck von Institutionen in der Zukunft darin bestehen würde, Wahrheit zu zertifizieren. Nicht Inhalte zu produzieren – das macht die Maschine bereits im Überfluss –, sondern sie zu authentifizieren. Ein Siegel auf das zu drücken, was real ist, was bedeutungsvoll ist.

Die Medien, die Universität, die Studierenden – wir alle – unsere Rolle in der Zukunft wird vielleicht weniger im Schaffen als vielmehr im Beurteilen bestehen. Und diese Beurteilung kann nicht ausgelagert werden.